鹏程·盘古:大规模自回归中文预训练语言模型及应用

18306 次浏览

详情

在鹏城云脑Ⅱ上训练了全球首个拥有全开源2000亿参数的自回归中文预训练语言大模型——鹏程·盘古。鹏程·盘古模型基于1.1TB高质量中文训练数据,采用全场景人工智能计算框架MindSpore自动并行技术实现了五维并行训练策略,从而可将训练任务高效扩展到4096个处理器上。对比实验表明,在少样本或零样本情况下,鹏程·盘古模型在多个中文自然语言理解或生成任务上都具有较优的性能。在此基础上,鹏程·盘古模型在大模型压缩、提示微调学习、多任务学习以及持续学习等方面也取得了很好的应用效果。

#免责声明#

来源:鹏城实验室等,版权归原作者所有。仅供参考学习,禁止用户商业通途。如涉及作品版权问题,请联系我们删除!

推荐报告

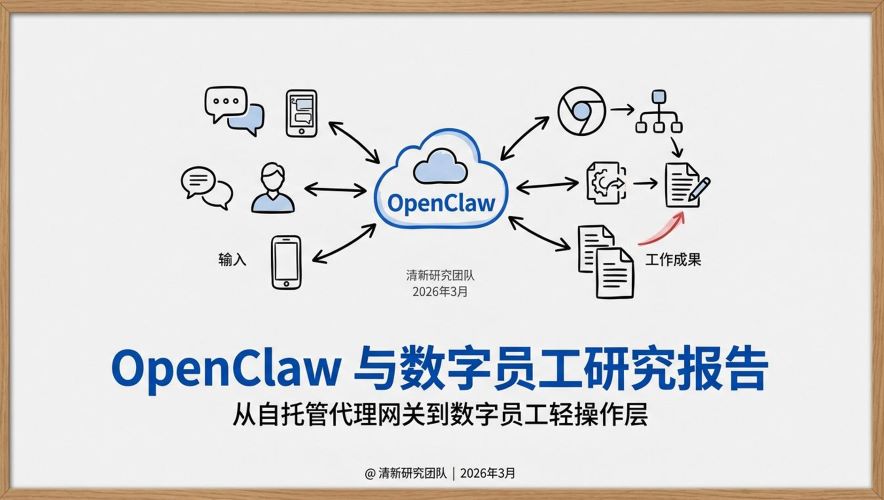

-

详细内容请点击查阅...上传时间:2026-03-25 11:32:00.0

-

详细内容请点击查阅...上传时间:2026-03-25 11:28:06.0

-

详细内容请点击查阅...上传时间:2026-03-24 18:01:43.0

-

详细内容请点击查阅...上传时间:2026-03-24 17:55:53.0

-

详细内容请点击查阅...上传时间:2026-03-23 09:23:28.0

-

详细内容请点击查阅...上传时间:2026-03-23 08:59:47.0

联系客服

联系客服